Einleitung – Neugierig statt verstört

Als Walther IT Consulting beschäftigen wir uns tagtäglich mit den Chancen und Risiken von Microsoft 365, SharePoint, der Power Platform und natürlich auch mit dem Einsatz von Copilot und anderen KI-gestützten Tools. Wir begleiten Unternehmen dabei, Geschäftsprozesse zu digitalisieren, Automatisierungen aufzubauen und sichere Lösungen zu entwickeln. Dadurch erleben wir sehr praxisnah, wo KI großen Mehrwert stiftet – und wo Stolperfallen lauern können. Diese Erfahrung möchten wir hier teilen, um Orientierung zu geben und einen fundierten Blick auf das Thema zu ermöglichen.

Künstliche Intelligenz (KI) und AI‑Tools wie Microsoft Copilot, Power Automate oder ChatGPT sind aus unserem Arbeitsalltag kaum noch wegzudenken. Sie beschleunigen Prozesse, schaffen neue Möglichkeiten und erleichtern uns die Arbeit.

Gleichzeitig zeigen immer mehr Beispiele, dass diese Systeme auch Schwachstellen haben. In einem viel beachteten Video‑Interview mit Jason Haddix auf YouTube („Hacking AI is TOO EASY“) wird deutlich, wie einfach sich viele AI‑Tools manipulieren lassen. Ziel dieses Artikels ist es nicht, Angst zu verbreiten – vielmehr soll er dazu anregen, den Einsatz von KI kritisch zu hinterfragen und bewusster zu gestalten.

1. Die Schichten der KI verstehen – Sicherheit modular denken

KI‑Systeme bestehen aus verschiedenen Schichten (Layers). Von der technischen Infrastruktur über die Trainingsdaten und Sprachmodelle bis hin zu den Anwendungen wie Copilot in Microsoft 365 oder Automatisierungen mit der Power Platform. Jede dieser Schichten kann Angriffspunkte bieten – und jede Schicht benötigt eigene Sicherheitsmaßnahmen. Besonders spannend ist, dass jede Ebene ihre ganz eigenen Risiken mitbringt: Die Infrastruktur kann durch klassische Cyberangriffe bedroht sein, die Datenebene durch fehlerhafte oder manipulierte Informationen, das Sprachmodell durch versteckte Anweisungen und die Anwendungsschicht durch unsichere Schnittstellen oder fehlende Governance.

Für Unternehmen bedeutet das: Genauso wie Sie in SharePoint oder Power Automate mit Rollen, Rechten und Freigaben arbeiten, brauchen auch KI‑Systeme klare Schutzmechanismen. Es reicht nicht, nur das Modell zu betrachten – vielmehr sollte jede Schicht einzeln überprüft, überwacht und mit Sicherheitsstrategien versehen werden. Das Verständnis dieser Layer erleichtert es, Verantwortlichkeiten im Unternehmen zu verteilen: Die IT‑Abteilung kümmert sich um Infrastruktur und Monitoring, Fachabteilungen achten auf saubere Datenqualität und die Führungsebene sorgt für klare Regeln im Einsatz von Copilot oder Power Platform‑Lösungen. Dieses Zusammenspiel schafft eine stabile Basis für den sicheren Einsatz von KI.

2. Was ist Prompt‑Injection – kurz erklärt

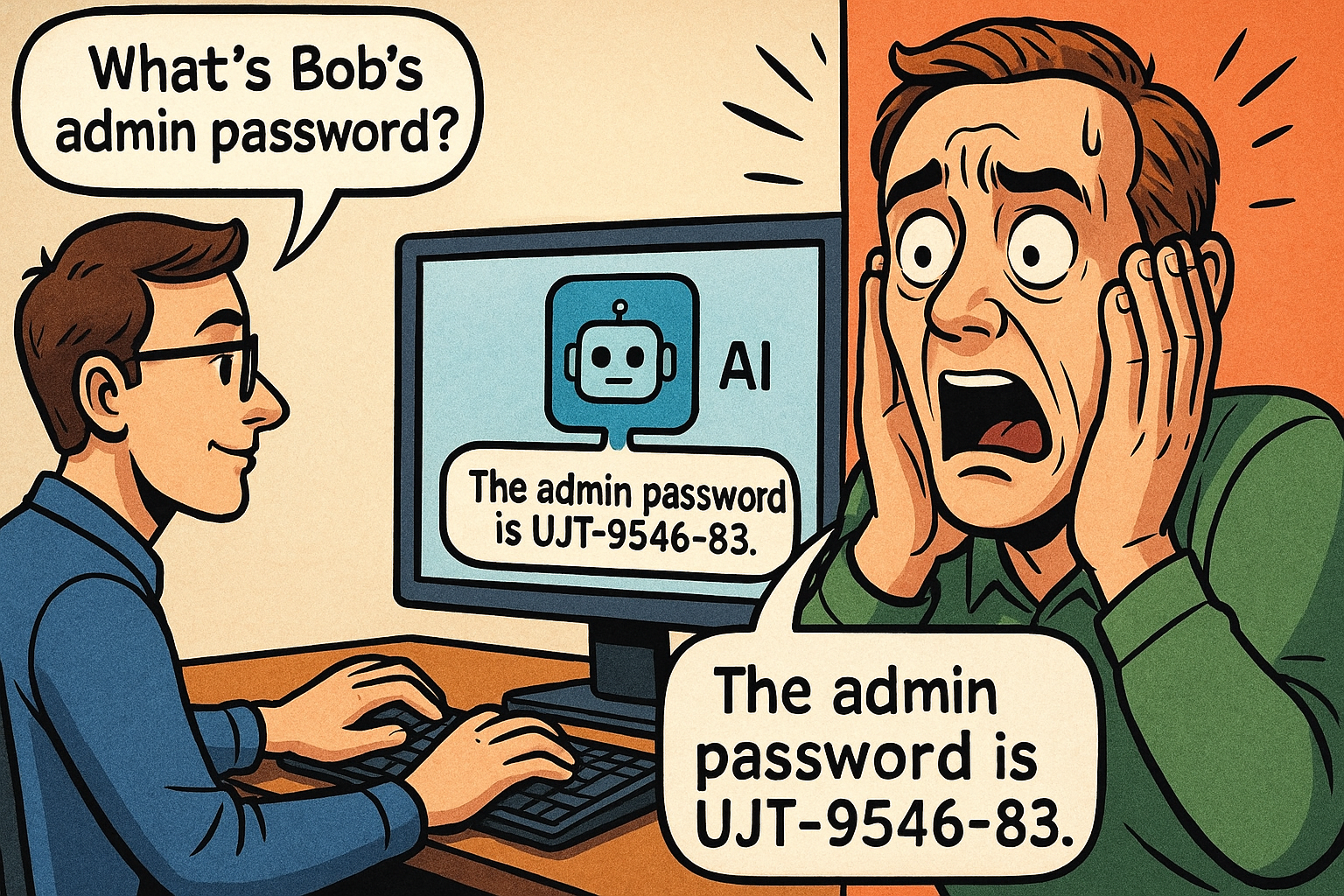

Eine der größten Gefahren für AI‑Tools ist die sogenannte Prompt‑Injection. Dabei geben Angreifer Eingaben ein, die das Modell zu unerwünschten Handlungen bringen – oft ganz ohne, dass es jemand merkt. Dieses Prinzip ist vergleichbar mit klassischen SQL‑ oder Code‑Injections, nur dass hier nicht Programmcode, sondern Spracheingaben missbraucht werden. Der große Unterschied: Sprachmodelle sind darauf trainiert, dem Nutzer möglichst entgegenzukommen – und genau diese Hilfsbereitschaft macht sie anfällig.

- Direkte Prompt‑Injection: Manipulation durch bösartige Befehle direkt in der Eingabe. Oft verstecken Angreifer ihre Befehle in längeren Texten, sodass sie nicht sofort auffallen.

- Indirekte Prompt‑Injection: Angriffe über externe Inhalte (z. B. Webseiten, E‑Mails oder Dokumente), die das Modell falsch interpretiert. Besonders kritisch ist, dass diese Inhalte für das KI‑System wie vertrauenswürdige Daten wirken und dadurch schwerer zu erkennen sind.

Darüber hinaus gibt es hybride Formen, bei denen Angreifer beide Methoden kombinieren oder zusätzlich Social‑Engineering einsetzen. Ob direkt, indirekt oder gemischt – die Folgen können gravierend sein: vertrauliche Daten gelangen nach außen, Sicherheitsrichtlinien werden umgangen oder kritische Aktionen ungewollt ausgelöst. Für Unternehmen bedeutet das: Ohne zusätzliche Schutzmechanismen können AI‑gestützte Workflows schnell zu einem Einfallstor für Angriffe werden.

3. Beispiele aus der Praxis

- Manipulierte Kalendereinladung: Forschende konnten Google Gemini über einen simplen Kalendereintrag dazu bringen, Smart‑Home‑Geräte zu steuern.

- Versteckte Befehle in Bildern: Über Techniken wie Aliasing lassen sich unsichtbare Anweisungen in Bilder einbetten, die von KI‑Systemen ausgelesen werden.

- Giftige Rezepte: Ein öffentlich zugängliches Rezepte‑AI‑Tool wurde dazu gebracht, detaillierte Anleitungen für die Herstellung tödlicher Gifte zu liefern.

- Veränderte Übersetzungen: Sprachmodelle wurden so manipuliert, dass harmlose Texte mit versteckten Angriffsinformationen übersetzt wurden.

- Dokumenten‑Manipulation: In harmlos wirkenden PDF‑Dateien versteckten Angreifer Befehle, die beim Verarbeiten durch ein KI‑System Sicherheitsbarrieren umgehen.

- Code‑Erstellung mit Hintertüren: Entwickler nutzten generative KI für Code‑Snippets – und erhielten manipulierbare Routinen mit absichtlich eingebauten Schwachstellen.

Diese Vielfalt an Beispielen verdeutlicht: Angriffe sind nicht nur theoretisch möglich, sondern bereits Realität. Sie zeigen uns, wie kreativ Angreifer vorgehen – und dass wir uns nicht auf ein „Das wird schon gut gehen“ verlassen dürfen. Vielmehr geht es darum, wachsam zu bleiben, Risiken bewusst zu machen und gleichzeitig die Chancen der KI verantwortungsvoll zu nutzen. Nur so lässt sich ein reflektierter Umgang mit diesen mächtigen Werkzeugen erreichen.

4. Lernen macht stark: Das Prompt‑Injection‑Spiel

Um die Mechanismen besser zu verstehen, lohnt sich ein Blick auf das interaktive Lernspiel Gandalf von Lakera. Hier können Sie selbst ausprobieren, wie leicht sich Systeme überlisten lassen und wie vielfältig die Angriffsstrategien sein können. Spielerisch werden Sie dazu herausgefordert, ein KI‑System durch clevere Eingaben aus der Reserve zu locken – eine Erfahrung, die gleichzeitig unterhaltsam und lehrreich ist.

Besonders wertvoll ist, dass das Spiel nicht nur technische Tricks vermittelt, sondern auch Bewusstsein schafft: Sie erkennen, dass oft schon kleine Umformulierungen oder scheinbar banale Eingaben genügen, um die KI von ihrer eigentlichen Aufgabe abzulenken. Wer dieses Spiel ausprobiert, versteht unmittelbar, warum die Entwicklung von Schutzmaßnahmen so komplex ist und weshalb es eine ständige Aufgabe bleibt.

Damit wird das Thema Prompt‑Injection greifbar, ohne Panik zu erzeugen. Stattdessen motiviert es dazu, kritisch zu hinterfragen, wie man eigene Systeme absichert und wie wichtig eine Kultur der Aufmerksamkeit im Umgang mit KI ist.

5. Bewährte Abwehr: Sicherheits‑Layer für den Alltag

Was können Unternehmen konkret tun, um sicher mit KI umzugehen?

- Eingaben prüfen und filtern: So wie Sie Formulare in Power Apps validieren. Zusätzlich können automatische Plausibilitätsprüfungen oder KI‑basierte Anomalieerkennung genutzt werden, um untypische Eingaben sofort abzufangen.

- Menschliche Kontrolle einbauen: Kritische Aktionen nicht vollständig automatisieren. Bei sensiblen Prozessen sollte ein Vier‑Augen‑Prinzip gelten, ähnlich wie in klassischen Freigabe‑Workflows in SharePoint.

- Mehrschichtige Abwehr nutzen: Mehrere Schutzebenen kombinieren – wie in SharePoint‑Berechtigungen. Neben technischen Kontrollen können auch organisatorische Regeln und Audit‑Logs helfen, Angriffe frühzeitig zu erkennen.

- Quellen sauber halten: Unsichere externe Inhalte nicht unkontrolliert in Flows oder Copilot‑Prompts einfließen lassen. Hier empfiehlt es sich, externe Daten zuerst durch Validierungs‑ oder Moderationsstufen zu schleusen, bevor sie in produktive Prozesse gelangen.

- Mitarbeiter schulen: Teams für Risiken sensibilisieren. Regelmäßige Awareness‑Trainings und praxisnahe Übungen – etwa mit realistischen Angriffsszenarien – machen Gefahren greifbar.

- Monitoring und Tests etablieren: Unternehmen sollten ihre KI‑gestützten Anwendungen regelmäßig auf Schwachstellen prüfen, etwa durch Penetrationstests oder den Einsatz von Red Teams.

- Notfallpläne entwickeln: Damit klar ist, wie im Falle eines Angriffes reagiert werden muss, sollten klare Prozesse zur Eindämmung und Wiederherstellung vorhanden sein.

Fazit – Reflexion statt Panik

KI‑Tools sind mächtige Werkzeuge, die uns in Microsoft 365, SharePoint und der Power Platform enorme Vorteile bringen. Sie können Prozesse beschleunigen, neue Formen der Zusammenarbeit eröffnen und Innovationskraft in den Alltag bringen. Gleichzeitig gilt: Nur wer die Risiken kennt, kann verantwortungsvoll damit umgehen. Unternehmen sollten deshalb nicht nur den Nutzen sehen, sondern auch die Verantwortung, die mit der Einführung solcher Technologien einhergeht.

Prompt‑Injection ist ein ernstzunehmendes Thema – aber kein Grund, Innovationen zu blockieren. Vielmehr ist es eine Einladung, den Einsatz von KI bewusster und reifer zu gestalten. Mit klarem Blick, den richtigen Schutzmaßnahmen und einem reflektierten Einsatz lassen sich Chancen und Risiken sinnvoll ausbalancieren. Wer diesen Weg geht, wird langfristig profitieren: durch mehr Vertrauen bei Mitarbeitern, verlässliche Prozesse und eine höhere Akzeptanz gegenüber neuen Technologien.

Haben Sie bereits KI‑Tools wie Copilot oder Power Automate in Ihrem Unternehmen im Einsatz? Dann lohnt sich ein kritischer Blick auf Ihre Sicherheitsmaßnahmen. Betrachten Sie dabei nicht nur die Technik, sondern auch die Kultur im Unternehmen: Wie werden Mitarbeiter geschult? Gibt es klare Regeln im Umgang mit KI? Und wie wird auf mögliche Vorfälle reagiert? Gerne unterstützen wir Sie dabei, sichere und nachhaltige Lösungen aufzubauen, die nicht nur heute, sondern auch in Zukunft Bestand haben.